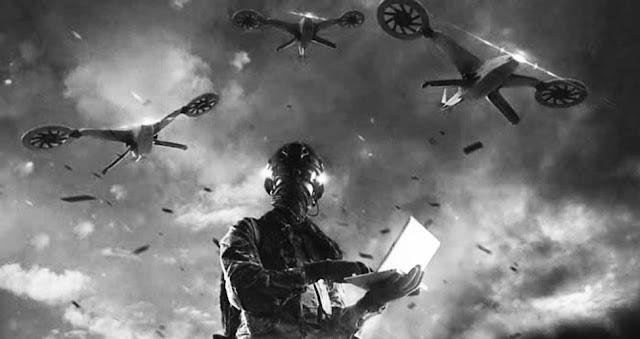

Οι νέοι πόλεμοι μέχρι το 2040 - Η στρατιωτική ρομποτική και η νέα ισορροπία του τρόμου.

Ο γεωπολιτικός ανταγωνισμός και η ραγδαία εξέλιξη της τεχνολογίας αλλάζουν ακόμη και τον χαρακτήρα των πολέμων.

Τα τελευταία 50 χρόνια οι πόλεμοι μεταξύ κρατών έγιναν πολύ σπάνιοι και οι πόλεμοι μεταξύ υπερδυνάμεων θεωρούνται πρακτικά αδιανόητοι για τρεις βασικούς λόγους:

Την ολέθρια απειλή των πυρηνικών όπλων.

Τους διεθνείς νομικούς περιορισμούς.

Την όλο και μικρότερη «όρεξη» για βία σε σχετικά ευημερούσες κοινωνίες.

Από την άλλη, εμφύλιοι πόλεμοι, ειδικά σε φτωχότερες χώρες, έγιναν πολύ συνηθισμένοι και συχνά μεγάλης διάρκειας. Αυτή η τάση αναμένεται να συνεχιστεί, λόγω της αύξησης των πληθυσμών, της κλιματικής αλλαγής και του εθνικιστικού εξτρεμισμού. Όλο και περισσότερο, μάλιστα, αναμένεται να διεξάγονται εμφύλιοι κυρίως σε αστικό περιβάλλον, αφού ως το 2040 τα δύο τρίτα του παγκόσμιου πληθυσμού θα ζουν σε πόλεις. Κάθε χρόνο περί τα 80 εκατομμύρια άνθρωποι μετακινούνται από αγροτικές σε αστικές περιοχές.

Ο «Economist» επιστράτευσε ειδικούς στους τομείς της γεωπολιτικής, της τεχνολογίας και του πολέμου για να επιχειρήσουν να σκιαγραφήσουν ποια μορφή θα έχουν και ποια θα είναι τα κύρια χαρακτηριστικά των πολέμων που θα βιώσουμε στο όχι και τόσο μακρινό μέλλον. Οι προβλέψεις περιορίζονται στα 20 χρόνια από σήμερα, αφού πέρα από αυτό το διάστημα οι αβεβαιότητες γίνονται τόσο πολλές ώστε δεν επιτρέπουν ασφαλείς εκτιμήσεις.

ΗΠΑ και Ρωσία εκσυγχρονίζουν τις πυρηνικές τους δυνάμεις δαπανώντας αστρονομικά ποσά και η Κίνα από την μεριά της αυξάνει το πυρηνικό της οπλοστάσιο. Αναπόφευκτα τα πυρηνικά όπλα θα παραμείνουν στο παιχνίδι τουλάχιστον μέχρι το τέλος του αιώνα. Όμως, είναι ένας άλλος, νέος παράγοντας που σύντομα θα αποτελεί τον καταλύτη στην «ισορροπία του τρόμου».

ΗΠΑ, Ρωσία και Κίνα ρίχνουν πια το βάρος στη στρατιωτική ρομποτική και τα αυτόνομα οπλικά συστήματα. Κι άλλες χώρες ήδη ακολουθούν. Τα συστήματα αυτά βασίζονται στην Τεχνητή Νοημοσύνη και πρόκειται να αλλάξουν τον τρόπο που διεξάγονται οι πόλεμοι, τη φύση των πολέμων, ακόμα και τον τρόπο που οι άνθρωποι αντιμετωπίζουν τους πολέμους. Ο μεγάλος κίνδυνος είναι ότι αυτά τα αυτόνομα οπλικά συστήματα θα είναι σε θέση να πάρουν αποφάσεις για να αφαιρέσουν ανθρώπινες ζωές. Οι αποφάσεις αυτές θα μπορούν να λαμβάνονται μελλοντικά ακόμη και ανεξάρτητα από αυτούς που δημιούργησαν τα οπλικά συστήματα.

Ο άνθρωπος τις αποφάσεις;

Η συζήτηση στο Πεντάγωνο και τα στρατιωτικά επιτελεία των υπολοίπων μεγάλων δυνάμεων αφορά το ποια ακριβώς θα πρέπει να είναι η αλληλεπίδραση ανθρώπων - επικεφαλής χειριστών με μηχανές ικανές για διάφορες βαθμίδες αυτονομίας.

Θα πρέπει ένας άνθρωπος να επιβλέπει μονίμως την επιχείρηση και να παραμένει πάντα ο υπεύθυνος για τις κρίσιμες αποφάσεις;

Θα πρέπει απλώς να επιβλέπει, με τη δυνατότητα να παρέμβει σε οποιοδήποτε στάδιο της επιχείρησης;

Ή θα είναι η μηχανή - οπλικό σύστημα αυτή που θα επιχειρεί, βάσει του αρχικού σχεδιασμού, χωρίς να υπάρχει καμία περαιτέρω ανθρώπινη παρέμβαση;

Αν μέχρι πριν από λίγες δεκαετίες κάποιοι θα χαρακτήριζαν ως «επιστημονική φαντασία» για το Χόλιγουντ τέτοια σενάρια, σήμερα μπορούμε πλέον να μιλάμε για «πραγματικότητα».

Τα δυτικά στρατιωτικά επιτελεία επιμένουν, σύμφωνα με τον «Economist», ότι, για να υπάρχει συμμόρφωση όχι μόνο της αυτονόητης ηθικής αλλά και των κανόνων της ένοπλης σύγκρουσης, θα πρέπει πάντοτε να είναι ένας άνθρωπος επικεφαλής, που να έχει, το λιγότερο, δυνατότητα παρέμβασης. Όμως, άλλες χώρες εκτιμάται ότι δεν θα είναι τόσο επίμονες σε αυτήν τη «λεπτομέρεια» από τη στιγμή που τα πλήρως αυτόνομα συστήματα παρέχουν σημαντικά στρατιωτικά πλεονεκτήματα.

Το 2014 το Πεντάγωνο ανακοίνωσε επίσημα ότι η μελλοντική του στρατηγική για να ανακτήσει τη στρατιωτική πρωτιά θα είναι να χρησιμοποιήσει μια γκάμα τεχνολογιών από τη ρομποτική, τα αυτόνομα συστήματα και τα big data και να το κάνει γρηγορότερα και αποτελεσματικότερα από κάθε άλλη χώρα. Αυτό που δημιουργείται είναι στην ουσία μια σειρά τεχνολογιών που θα αλλάξουν ριζικά το παιχνίδι: Τεχνητή Νοημοσύνη, big data, μηχανική μάθηση, μεγάλης κλίμακας αναλύσεις δεδομένων και ρομποτική. Όλα αυτά μαζί θα δημιουργήσουν οπλικά συστήματα με διάφορους βαθμούς αυτονομίας, από το να λειτουργούν υπό την ανθρώπινη επίβλεψη μέχρι να σκέφτονται, να αποφασίζουν και να εκτελούν τελείως μόνα τους.

Οι αλγόριθμοι θα κρίνουν πολέμους

Ο πιο αποφασιστικός παράγοντας στους πολέμους του μέλλοντος θα είναι η ποιότητα των αλγορίθμων (!) που θα διαθέτει η κάθε πλευρά. Ο Φρανκ Χόφμαν, Αμερικανός ειδικός του Πανεπιστημίου Εθνικής Άμυνας και υπεύθυνος για τον όρο «υβριδικός πόλεμος», πιστεύει ότι πρώτη φορά στην ιστορία οι ανθρώπινοι παράγοντες που μέχρι σήμερα καθόριζαν την έκβαση των πολέμων – η θέληση, ο φόβος, η λήψη αποφάσεων και η ανθρώπινη ευφυΐα – είτε θα είναι λιγότερο εμφανείς είτε, σχεδόν, θα εκλείψουν.

Τα όπλα με σχετικό βαθμό αυτονομίας δεν είναι κάτι καινούργιο. Πρώτη τα κατασκεύασε η ναζιστική Γερμανία το 1943. Επρόκειτο για μια τορπίλη με έναν ειδικό ακουστικό μηχανισμό που της επέτρεπε να βρει τον στόχο της. Σήμερα πολλά αντιπυραυλικά συστήματα είναι προγραμματισμένα να αποφασίζουν μόνα τους πότε να στοχεύσουν έναν στόχο, γιατί ο ανθρώπινος εγκέφαλος δεν μπορεί να αντιδράσει αρκετά γρήγορα.

Όμως το είδος της αυτονομίας των συστημάτων που έρχονται θα είναι κάτι τελείως διαφορετικό. Το 2016, το Επιστημονικό Συμβούλιο Άμυνας του Πενταγώνου απεφάνθη ότι «για να είναι αυτόνομο ένα σύστημα, πρέπει να έχει τη δυνατότητα να “συνθέτει” ανεξάρτητα και να επιλέγει το ίδιο μεταξύ διαφόρων τρόπων για να επιτύχει τους στόχους του, βασιζόμενο στην “κατανόηση” του κόσμου, του εαυτού του και της κάθε δεδομένης κατάστασης». Εν ολίγοις, να αποφασίζει!

Θα πρέπει να γίνει ένας διαχωρισμός μεταξύ της «στενής» Τεχνητής Νοημοσύνης, δηλαδή αυτής που επιτρέπει σε μια μηχανή να επιτελέσει μια λειτουργία καλύτερα από ό,τι ένας άνθρωπος και που ήδη έχει διάφορες χρήσεις, όπως π.χ. τα αυτόνομα οχήματα, και της «γενικευμένης» Τεχνητής Νοημοσύνης, που θα έχει πολύ ευρύτερες εφαρμογές.

Υπολογίζεται ότι απέχουμε ακόμα 20 χρόνια από την «γενικευμένη» Τεχνητή Νοημοσύνη, το είδος που θα δημιουργήσει τα απολύτως αυτόνομα οπλικά συστήματα. Μια τέτοια «μηχανή» θα μπορεί να κρίνει, να σχεδιάζει, να σκέφτεται αφηρημένα, να λύνει προβλήματα και να μαθαίνει από τις εμπειρίες της. Τέτοια πρώιμα συστήματα δημιουργούνται ήδη: «Μαθαίνουν» από τους ατελείωτους όγκους data που προέρχονται από τα social media και από drones παρακολούθησης.

Η μηχανή εκπαίδευσης Τεχνητής Νοημοσύνης AlphaGo Zero κατάφερε πέρυσι, παίζοντας εκατομμύρια παιχνίδια στρατηγικής με τον εαυτό της μέσα σε μόλις 40 μέρες, να ανακαλύψει στρατηγικές που σε εμάς χρειάστηκαν χιλιάδες χρόνια για να αναπτύξουμε. Το γεγονός χαρακτηρίστηκε ως επαναστατικό βήμα προόδου προς τη δημιουργία ακριβώς αυτού του είδους των αλγορίθμων που θα τροφοδοτούν τα πραγματικά «έξυπνα» αυτόνομα συστήματα.

Χωρίς φόβο, εξάντληση ή οργή

Στο μεταξύ οι στρατιωτικές εφαρμογές της «στενής» Τεχνητής Νοημοσύνης, αυτής που ήδη κατέχουμε, είναι ήδη έτοιμες να φέρουν μια ακόμη επανάσταση: τη συνεργασία ανθρώπων - μηχανών και το λεγόμενο «combat teaming». Δηλαδή τη συνεργασία επανδρωμένων και μη επανδρωμένων πολεμικών συστημάτων στις μάχες. Σε τέτοιες πολεμικές αποστολές - συνεργασίες οι άνθρωποι, π.χ. ο πιλότος του επανδρωμένου μαχητικού αεροσκάφους, θα ορίζει τον στόχο αλλά θα είναι, τελικά, το μη επανδρωμένο αυτό που θα αποφασίζει το πώς θα εκτελέσει ό,τι του ανατέθηκε και πώς θα αντεπεξέλθει σε οποιαδήποτε απρόσμενη πρόκληση.

Τα αυτόνομα μη επανδρωμένα συστήματα, είτε στον αέρα, είτε στην ξηρά, είτε στη θάλασσα, θεωρείται ήδη ότι προσφέρουν πολλά πλεονεκτήματα. Εκτός του ότι εξοικονομούν χρήματα και προσωπικό, μπορούν να είναι τολμηρότερα και αποτελεσματικότερα αφού δεν νιώθουν φόβο, εξάντληση ή οργή. Επίσης θα είναι φθηνότερα και μικρότερα, αφού δεν θα χρειάζεται να «προστατεύουν» ανθρώπους από εχθρικά χτυπήματα. Τέτοια αυτόνομα αεροσκάφη θα αποτελούν σύντομα την αιχμή του δόρατος στην αεράμυνα του Πενταγώνου.

Το Ισραήλ, άλλωστε, ήδη έχει σε πλήρη λειτουργία το Harop, ένα πλήρες αυτόνομο αεροσκάφος που μπορεί να πετάει ως και έξι ώρες συνεχόμενα και να επιτίθεται από μόνο του όταν ανιχνεύσει εχθρικό στίγμα στο ραντάρ.

Σμήνη ρομποτικών συστημάτων

Η μεγαλύτερη άμεση αλλαγή στον τρόπο που διεξάγονται οι πόλεμοι θα έρθει με την ταυτόχρονη δυνατότητα ανάπτυξης ολόκληρου σμήνους από ρομποτικά συστήματα (ρομποτικά πολεμικά αεροσκάφη).

Συλλογικά, τα σμήνη ρομποτικών συστημάτων θα επιφέρουν δραματικές αλλαγές στις στρατιωτικές επιχειρήσεις. Για τις ΗΠΑ αποτελούν τη λύση σε ένα μεγάλο πρόβλημα, αυτό του δυσβάσταχτου κόστους. Οι αμερικανικές ένοπλες δυνάμεις, για να παραμένουν πρώτη στρατιωτική δύναμη παγκοσμίως, εξαρτώνται από πανάκριβα οπλικά συστήματα, τα οποία, σε περίπτωση απώλειάς τους σε τυχόν μάχες, είναι εξαιρετικά δαπανηρό και δύσκολο να αντικατασταθούν. Ενδεικτικά, ένα μόνο αεροσκάφος F35 κοστίζει τουλάχιστον 100 εκατ. δολάρια, ένα πολεμικό υποβρύχιο 2,7 δισ. δολάρια και ένα αεροπλανοφόρο 20 δισ. δολάρια.

Είναι βέβαιο ότι σμήνη αυτόνομων οπλικών συστημάτων θα εμφανιστούν στις μάχες μέσα στα επόμενα χρόνια. Αυτό που δεν ξέρουμε είναι αν θα είναι η Αμερική αυτή που θα τα αποκτήσει πρώτη.

Τον Ιούλιο η Κίνα παρουσίασε το «Σχέδιο Ανάπτυξης Τεχνητής Νοημοσύνης Νέας Γενιάς», που καθορίζει την Τεχνητή Νοημοσύνη ως την τεχνολογία που θα ορίσει τη στρατιωτική και οικονομική κυριαρχία στο μέλλον. Η Κίνα ανακοίνωσε ότι στοχεύει να γίνει η κυρίαρχος υπερδύναμη στην Τεχνητή Νοημοσύνη έως το 2030.

Ο Βλαντίμιρ Πούτιν δήλωσε τον Σεπτέμβριο: «Η Τεχνητή Νοημοσύνη είναι το μέλλον, όχι μόνο για τη Ρωσία, αλλά για όλη την ανθρωπότητα. Όποιος γίνει ο ηγέτης σε αυτόν τον τομέα θα γίνει ο κυρίαρχος του κόσμου».

Ο Ίλον Μασκ, πρόεδρος των παντοδύναμων εταιρειών τεχνολογίας Tesla Motors και SpaceX, σχολίασε ότι «ο ανταγωνισμός σε επίπεδο κρατών για την υπεροχή στην Τεχνητή Νοημοσύνη είναι η πιο πιθανή αιτία για τον Τρίτο Παγκόσμιο Πόλεμο».

Η νέα κούρσα εξοπλισμών

Ο ανταγωνισμός για την Τεχνητή Νοημοσύνη άρχισε να προκαλεί μια κούρσα εξοπλισμών που δημιουργεί πρωτοφανή ανασφάλεια. Η επανάσταση στη στρατιωτική ρομποτική βρίσκεται προ των πυλών και θέτει ηθικά, πολιτικά, νομικά και πρακτικά ζητήματα εντελώς νέου είδους. Το μέγα ερώτημα είναι αν αυτή η κούρσα μπορεί να περιοριστεί και αν οι κανόνες για τη διασφάλιση ανθρώπινου ελέγχου πάνω στα αυτόνομα συστήματα είναι δυνατόν να επιβληθούν ή ακόμα και να υπάρξουν.

Οι περισσότεροι ειδικοί συμφωνούν ότι, σε περιπτώσεις που χρησιμοποιείται «θανατηφόρα ισχύς», δηλαδή επιχειρήσεις που θα επιφέρουν και απώλεια ανθρωπίνων ζωών, θα πρέπει να υπάρχουν άνθρωποι που θα αποφασίζουν να ξεκινήσουν τη διαδικασία. Οι άνθρωποι απωθούνται, ακόμη τουλάχιστον, από την ιδέα οι μηχανές να μπορούν να κάνουν την επιλογή για το αν θα σκοτώσουν ανθρώπους. Δηλαδή ο άνθρωπος να επιλέγει την έναρξη μιας διαδικασίας, να πατάει απλά ένα κουμπί start, αλλά ένα πλήρως αυτόνομο σύστημα να έχει από εκεί κι έπειτα όλη την ευθύνη και δικαιοδοσία να φέρει μόνο του εις πέρας την κάθε αποστολή έως το τέλος.

Όμως, στην πράξη αποδεικνύεται δύσκολο το να καθοριστεί ακριβώς τι είδους ανθρώπινος έλεγχος θα υπάρχει και σε ποιο στάδιο, ενώ παράλληλα η τεχνολογία κινείται τώρα πια τόσο γρήγορα, ώστε αφήνει πίσω τη διεθνή διπλωματία.

Τα πράγματα περιπλέκονται περαιτέρω από το ότι οι πιο δραματικές πρόοδοι στην Τεχνητή Νοημοσύνη γίνονται από μεγάλες ιδιωτικές εταιρείες που έχουν εμπορικά κίνητρα. Που σημαίνει ότι, ακόμη κι αν υπάρξουν διεθνείς συμφωνίες για την απαγόρευση ρομποτικών στρατιωτικών συστημάτων, η τεχνολογία που καθιστά δυνατή την ύπαρξη αυτόνομων οπλικών συστημάτων θα υπάρχει και θα μπορεί πολύ εύκολα να αποκτηθεί.

Ποιος θα περάσει την «κόκκινη γραμμή»

Η εξοπλιστική κούρσα για την Τεχνητή Νοημοσύνη πυροδοτείται από έναν συνδυασμό δυνάμεων που πρακτικά είναι ασταμάτητος: γεωπολιτικό ανταγωνισμό, επιστήμη που αγγίζει τα σύνορα της γνώσης και τεχνολογικές επιχειρήσεις που επιζητούν τεράστια κέρδη.

Προς το παρόν, οι ένοπλες δυνάμεις στη Δύση είναι αποφασισμένες να έχουν παγίως ανθρώπους στον έλεγχο τουλάχιστον ενός μέρους των διαδικασιών. Η σχετική οδηγία του Πενταγώνου λέει συγκεκριμένα: «Τα αυτόνομα συστήματα θα σχεδιαστούν με τρόπο ώστε να επιτρέπουν σε χειριστές να ασκούν την κατάλληλη ανθρώπινη κρίση πάνω στη χρήση βίας. Τα άτομα αυτά (χειριστές) θα πρέπει να το πράττουν σύμφωνα με τους νόμους του πολέμου, τις ισχύουσες διεθνείς και νομικές συνθήκες και τους κανονισμούς των μαχών».

Όμως, αν και αυτή μπορεί να είναι η γενική πολιτική, κανείς δεν ξέρει αν άλλες δυνάμεις παραμένουν δεσμευμένες στον ανθρώπινο παράγοντα ή ακόμα αν και η ίδια η Δύση θα μπορεί μελλοντικά να το τηρεί απαρέγκλιτα. Ο λόγος είναι ότι, αν δεν υπάρχει η «λεπτομέρεια» του ανθρώπινου ελέγχου, ένα αυτόνομο σύστημα αντιδρά με... ταχύτητες φωτός αν, π.χ., δεχθεί επίθεση. Ο πειρασμός να αφήσουν το σύστημα να αναλάβει μόνο του δράση θα είναι τεράστιος και κάποια χώρα, σε κάποια κρίσιμη στιγμή, θεωρείται βέβαιο ότι θα ξεπεράσει την ηθική και λογική «κόκκινη γραμμή».

Το Πεντάγωνο εκτιμά ότι η Ρωσία διαθέτει ήδη ένα πλήρως αυτόματο σύστημα «αντίδρασης», που λειτουργεί αυτόνομα χωρίς καμία ανθρώπινη παρέμβαση ή παρουσία, με οδηγίες να εκτοξεύσει πυρηνικούς πυραύλους σε περίπτωση που οι αισθητήρες του (πίεσης, σεισμικής δραστηριότητας ή ραδιενέργειας) ανιχνεύσουν πυρηνική επίθεση...

14/2/2018